スマホ時代のコミュニケーション変革を先導してきたLINEが描く ひとに優しいAI社会実装戦略|砂金信一郎 氏(LINE株式会社 AIカンパニーLINE BRAIN室 室長)

Communication Tech Conference 2019 講演レポート

投稿日:2020年1月6日 | 更新日:2025年2月26日

皆さんこんにちは、LINEの砂金です。今日はAIのトピックに関して、私からお話させていただきます。

LINEが目指しているAIはどんなものかとよく聞かれますが、我々は「ひとに優しいAI」をキャッチフレーズにしています。これから5G時代になっていくと、世の中がすごく大きく変わっていきます。

しかし、人間と人間は会話したいというのは、変わらないものです。そのコミュニケーションが、電話、メッセージ、スタンプというように形が変わってきました。その皆さんのコミュニケーション支えているLINEがAIをどう考えていて、今後どんなことをやっていこうとしているのかをご紹介していきたいと思います。

こうした講演をする際に、最初に皆さんにお伺いすることがあります。日本なのでだいたい結果はわかっていますが、「日常あるいは仕事で、スマホアプリLINEをコミュニケーションのために使っている」という方、手をあげていただけますか?

これは海外からのゲストの方からみると、非常にインパクトがあります。海外では、英語圏で言うとWhatsAppを利用していますし、中国だったらWeChatです。

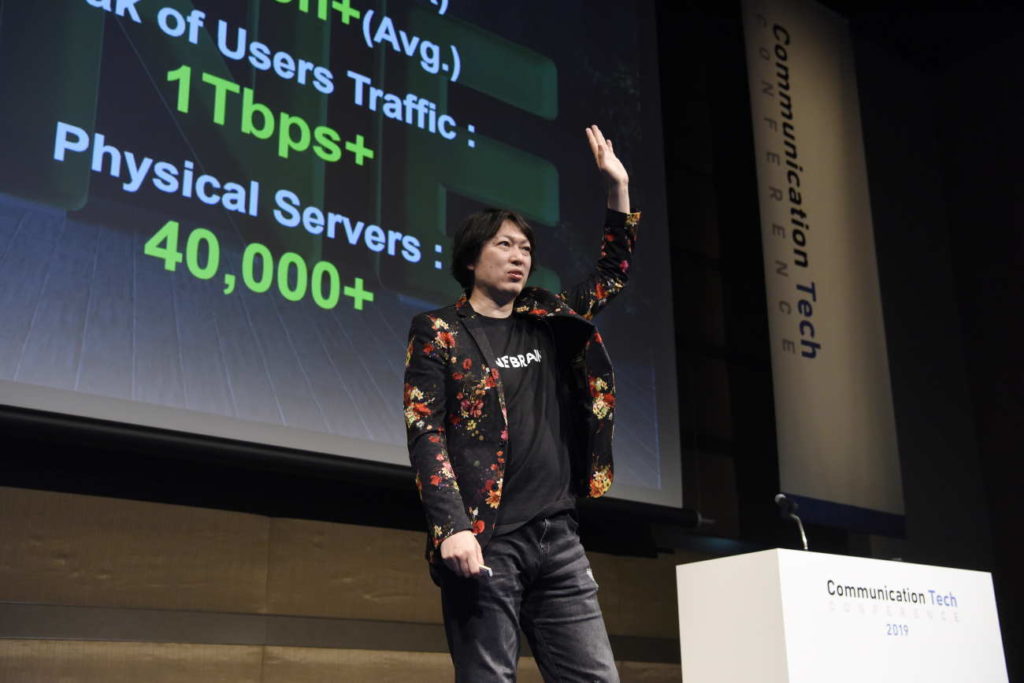

しかし、日本を含む東アジア圏だとLINEを使っている国が多い。しかも、そのシェアが圧倒的です。日本のMonthly Active Userは8,200万人で、

月に1回は何らかのサービスを使ってくれています。

よくスマホアプリについて「何百万ダウンロード突破!」などとCMが流れます。しかし、ダウンロードさせることと、その後ずっと使い続けてもらうことは違います。ダウンロードしてもらうだけなら簡単で、テレビCMなどを打てばダウンロード数が上がります。

ですが、ダウンロード後に登録してもらい、さらに3日間、1週間、1か月後と継続して使ってくれるかは違います。コミュニケーションのメッセンジャーであるLINEは、継続して使っていただいているユーザーが非常に多いのが特徴です。

そのサービスを支えるインフラとして膨大なデータお預かりをして、それをサービス改善につなげていくようなインフラもきちんと作っていく。これが、LINEの立ち位置です。

たくさんのデータをお預かりして、皆さんのためにより良いサービスを作っていくために、AIに関するプロダクトもいくつか世の中に出してきました。一つは、「LINE Clova」です。リビングにあって呼びかけると何かやってくれるようなスマートスピーカーを作ることにもAIが絡んでいます。

Yahoo!等で検索をするのと、スマートスピーカーに語りかけて音声で応答されるのは、 何か問い合わせをして答えが欲しいという目的では基本的に同じです。 ただ、インターネットの画面があるUIとvoice UI(音声で返すもの)には、決定的な違いがあります。

音声だと、問い合わせに対するオススメが20件あって、「上から20件を読み上げます」と言うと、誰も聴いてくれません。例えばGoogleで検索をした時に、画面を目で見るUI(ユーザーインターフェース)なら検索のランキング表示の中で自分が好きなものを選ぶことができます。ですが、音声応答の場合は結構これが難しく、「きっとあなたが欲しい答えはこれですよね」という1つ(または少数)を当てないといけないのです。

そうするとAIは、あなたが欲しいものはきっとこれだと推論を展開します。それで欲しいもの返します。ルールベースでもちろん実現できますが、まずその手前の日本語理解などが難しいので、その推論の結果の精度を上げるために裏側でAIの各種技術を組み合わせて実現をしています。

それ以外にも、このスライドにあるようにLINEがやっているAI技術を書き出すといっぱいあります。

だだし、我々は医療画像を正しく判定するAIを作りたいわけではありません。

我々の目指すのは、皆さん人間同士のコミュニケーションをより豊かにするためにサポートするAIです。比較的リソースも少ないため、絞って展開していますが、結果として様々なものができ上がっています。

冒頭で「ひとに優しいAI」とキャッチフレーズを紹介しました。これ英語にすると「Natural Experience」で、「自然な体験」となります。

例えば、LINEアプリの中で最近使っていないスタンプが推薦されて来たとき、それは裏でAIが動いています。そういう皆さんが気づかないところにすっと忍び寄って支えるという、自然な体験を作っていくAIを実現しています。

その中でも、大きなチャレンジをしている機能が「Smart Channel」です。機能名自体を見聞きしたことがないかもしれませんが、LINEのアプリ上に、今日の天気、ニュース、災害の情報などを出しています。これはSmart Channelのエリアです。他の場所の広告だと、なかなか見てくれないですが、あなたに適した広告をきちんと出すというような推論エンジン付きで出すと、非常に高い広告商品として売れています。

これを実現するためにLINEがやっているのは、メッセンジャーだけではありません。

ニュース、マンガ、ミュージックなどのサービスがありますが、その中からデータを全部取得してきます。普通のネット系アプリ系の企業だと、ニュース専用のデータ分析クラスターとニュース専用のデータサイエンティストがいて、サービスに対して最適化します。LINEも数年前まではそうでした。

しかし、現在は全てのサービスログをアーカイブできるクラスターを全社横断で作っています。その結果、ユーザーの行動データを推量する「User features」と、コンテンツを分類する「Contents features」という2つの巨大な特徴量を持っています。

ユーザーの特徴量は、現在5,000万次元となっています。非常に多くのデータをアプリから吸いだして、「きっとこの人はこういうことをやっている」、「こういうものが好きだ」というのを当てるためにたくさんのデータをユーザーの特徴量として持っています。

それを最適化するエンジンとして、例えばRecommendationで「きっとあなたはこういうニュースが好きそうですよ」っていうのを当ててあげます。また、Lookalikeがあります。例えば、地域や年齢をターゲットして広告を打つ場合、特定の人を絞り込んで行けば絞り込んでいくほど対象は少なくなります。

しかし、逆に絞り込んだところから条件を少し広げてあげると「きっとこの人に似た属性の人たちはこの辺までいます」ということが推奨できるわけです。こうしたことを行うのがLookalikeエンジンです。

LINEはこうした基本的な仕組みをパッケージ化して用意しています。それを使って「Smart Channel」を作ったりします。また、スマホアプリのエンジニアはこのエンジンを利用してLINEのアプリ開発をクイックにやっています。

LINEがプラットフォームになって、用意しているAI部品を皆さんにご提供しますという観点で始めているものに「LINE BRAIN」という事業があります。「LINE BRAIN」には様々なサービスがありますが、ひとつだけ特徴的なサービスを動画でご覧ください。

これは、実際にやってみると難しいポイントがあります。裏側のしくみを含めてご紹介します。

まず予約したい人がしゃべります。しかし、クリアな音声でしゃべってくれるかというと、地下鉄などの雑音が入る場合もあります。ですから、ノイズキャンセリングなど様々なことをやって日本語で何と言っているのかを理解しなければならない。ここが大変で、我々は「Speech To Text」という技術としてとらえています。日本語の音声をテキストに落とし込むものです。

音声からテキストに変換をして「土曜日の2時」を部品として取り出します。何日・何時・何人というのがレストランの予約においては、すごく大事な情報です。実はそれ以外はあまり重要ではありません。

だから、多少の聞き間違いをしてもいいのです。ただ、時間、人数だけはきちんと聞き出すまで諦めずに会話を繰り返して会話を組み立てるために、自然言語処理を搭載したエンジンを使っています。

さらに「その時間は空席があります」「予約可能です」「いっぱいなので他の時間にしてください」という応答も音声にして返さなくてはいけない。動画の冒頭で割と自然な音声を皆さんにお聞きいただけたと思います。

いわゆる音声合成された機械音みたいなものではなく、より自然な声(人間らしい声)を合成するにはどうしたらいいかを研究開発して提供しています。そして、「Text To Speech」という技術を組み合わせて、最終的には今みたいなユーザー体験を実現しています。

これは、発表した時点では研究開発のプロジェクトとして「DUET」という名称でした。先日ようやくAIの店員さんが顧客の電話にでるところまで作り上げて「LINE AiCall」というプロダクト名に変更してサービス提供が開始されています。

現在、一店舗だけですが、「俺のGrill&Bakery 大手町」に導入されています。固定電話から電話をして予約しようとするとAIと会話ができるので、ご興味ある方は実際に予約をしてレストランに行ってみてください。

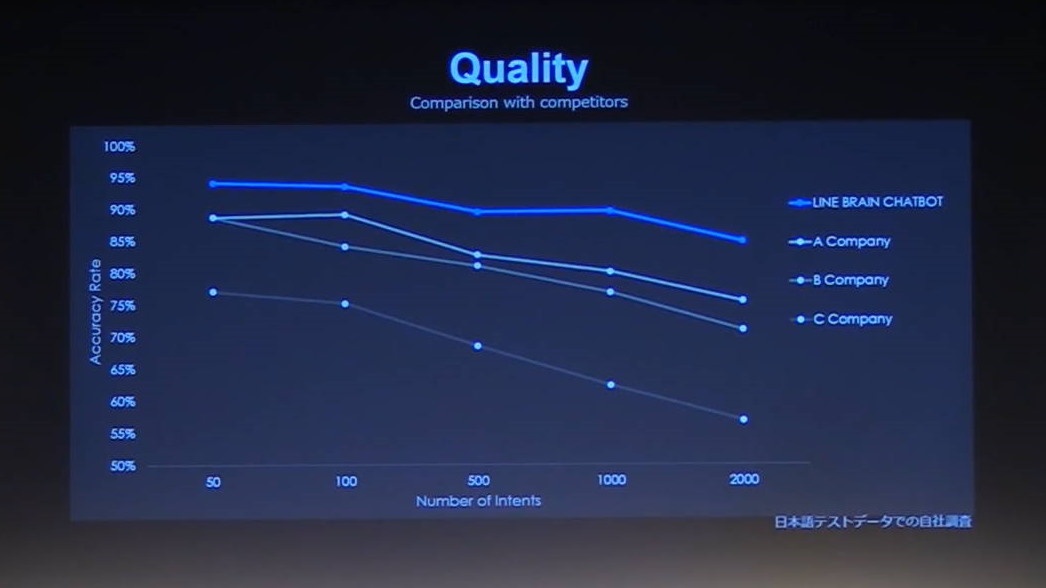

こうしたチャットボットなどと会話を組み立てた場合、正確性が非常に大事になります。どのくらいの精度でユーザーのやりたいことや困りごとを助けられるかが大切です。

これは、自社と他社のエンジンに同じデータを読み込ませて比較をしたものです。データを読み込ませてチャットをさせて、正しい答えを返せるかの検証をやっています。我々の技術は他のエンジンを上回っていることを示しています。

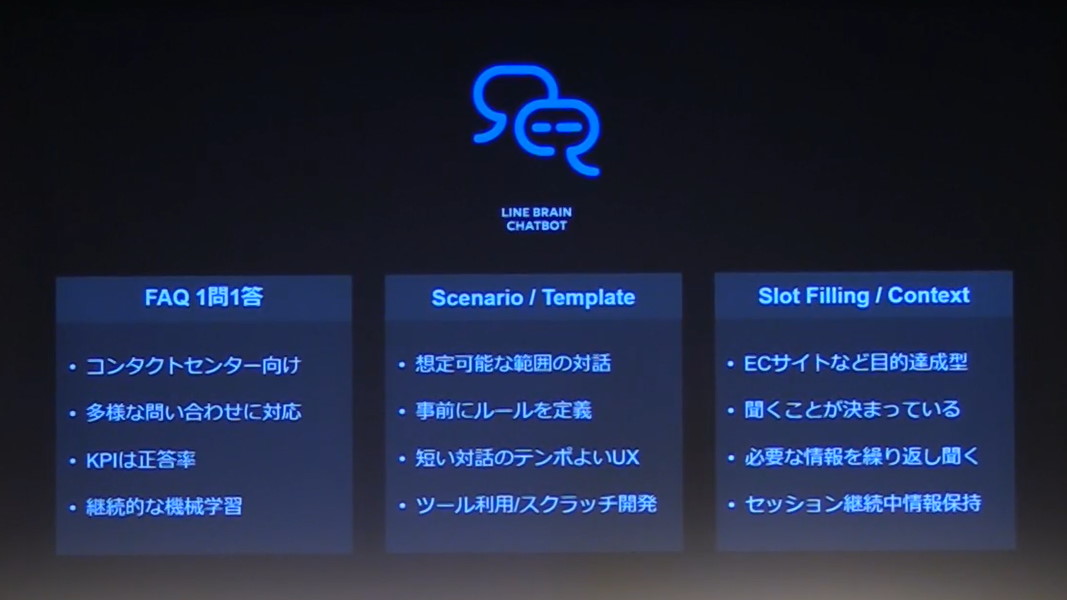

精度の高いチャットボットを実現するために、いろいろなことをやっています。我々はチャットボットを3つに切分けています。

1つ目は、コールセンター等で使えそうなFAQタイプです。質問に対して回答が合致するものです。これはどういう種類の質問かを分類する自然言語処理の技術が非常に重要になるエリアです。

例えば、新しいiPhoneが発売されると、機種変更の時にデータ引き継ぎができないという問い合わせが増えます。問い合わせに対して、きっとあなたがお困りの状況はこれだからこの回答を見てくださいと返すわけです。スマホのFAQについてはLINEにたくさん蓄積があるので、それをお返しすれば解決します。

これは、コールセンターの省力化という形で非常に役に立っています。実際、LINEは8,200万人のユーザーいるわけで、たくさんの問い合わせがきます。しかし、コンタクトセンターでカスタマーケアをするスタッフは驚くほど少ないです。これが実現できているのは我々のチャットボットが表にいるからです。

2つ目は、Scenario/Templateです。こちらは、昔からよくあるチャットボットのパターンです。ルールベースで、きっとユーザーはこれを言っている違いないというものです。

先ほどのLINEに対する問い合わせで言うと「あなたの使っているスマホはAndroidですかiOSですか?」その後に「バージョンは何を使っていますか?」という質問に選択式で答えて行くような、ルールベースの会話シナリオを作っていくものです。

3つ目についてです。先ほどのAiCallのところでお話ししましたが、電話予約では、時間人数、そして後最に聞くべきは予約した人の名前です。ここまでできると、店舗側としては「何月何日に何名で何々さんがいらっしゃる」ということが把握できる。これをSlot Fillingと呼んでいます。

現時点でAiCallはレストランの予約しかできません。キャンセルも変更も今はできません。しかし、新規予約を受けることに関しては、ほぼ間違いなくできます。どの業種のどういう課題に対してきちんと答えるべきか、AI研究開発のメンバーや自然言語処理系などいろいろな人たちが集まって課題解決しています。その中でできあがってきているのがLINEのAI技術です。

こうした技術を偉そうに誇りつつも、開発に3ヶ月もかかっていては、なかなか使っていただけません。そこで、簡単に設定ができる画面を用意しています。AIもFAQで間違うことがあります。本当はこう答えたら良かったとAIに教えてあげて再学習させる機能などを簡単に使える「CHATBOT Builder」を提供しています。

また、CHATBOTではなく、OCR(文字認識)機能にも同じように「OCR Builder」という設定画面があります。

OCRはドキュメントを流してテキストを返すだけなので、OCRを学習させる設定画面なんていらないだろうと思われがちです。しかし、請求書を例に考えましょう。日本では、請求書はテンプレート化されていません。各社各様の独自のフォーマットで請求書を送るのが日本の商習慣です。

請求書のどこに住所が書いてあって、会社名があって、明細がどうなっていて、金額はどこに記載されているか、税抜きか税込かなどなどを機械に読ませるのは大変です。

ですから、AIに対して、ここが明細で、ここは会社名だとかを最初に少し教えておけば、スムーズに読みことができます。それでも、たまに間違えてしまいます。その間違った時に、ここはこう読めば良かったと教えてあげると、そこからもう少しAIが賢くなっていくわけです。

LINEがどうしてOCRをやっているのだと疑問を持たれる方いらっしゃると思います。でも、実際にLINEのメッセージのアプリの中にも、写真をクリックして写真中の文字をなぞるとテキストが取り出せる機能があります。

また、他にもOCRの面白い使い方があります。Apple music、SpotifyのユーザーにLINE musicを使ってもらいたいとします。こういったユーザーから、以前のプレイリストをスクリーンショットして画像で送ってもらえば、その画像をOCRで変換して、以前聞いていたApple music、SpotifyのプレイリストをLINE musicに再現できます。このように、OCRという技術は使い勝手がいいわけです。

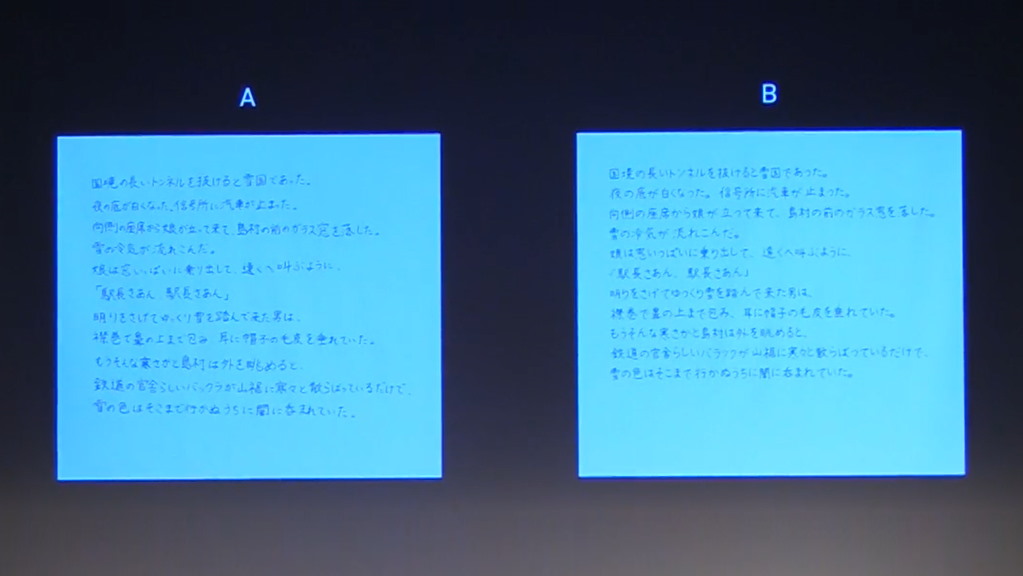

OCRについて、LINEが研究開発中のものをひとつ皆さんにご紹介します。ここに、AとBの2つの文字があります。ひとつは人間が書いた文字で、一方はAIがジェネレートした文字です。BがAIの作った文字です。

どういうことをやっているかというと、ある人に500字ぐらい書いてもらい、その人の字体の癖をAIが学習をして、その人っぽいフォント作ります。現在、Windows、MACでも使えるフォントを作り上げるところまでパッケージにしています。これがあれば、もう手書き文字を書かなくて良くなります。この手書き風フォントを使えば自分の文字みたいなものが出力できます。

なぜこれを紹介しているかといいますと、AI技術の精度を高めるためには学習データが必要だからです。多くの方は「LINEはいいですよね。ユーザーさんが多いのでユーザーからのデータを学習に使えるから」といいます。

確かにデータを使えはしますが、制限があります。皆さんのプライバシーを侵害することはできません。例えば、皆さんが知り合い同士でメッセージ交換しているテキストの内容は完全に暗号化されており、我々は一切読めません。ですから、データの集め方を工夫しなければいけません。

先ほどの、手書きフォントの技術は何に役立っているかというと、OCRが学習するためには、実際の手書き文字でも、手書き風のフォント文字でもいいわけです。ですから、AI自体が文字を生成して、それを学習のために使って、精度判定をしてモデルを変えることを自動的にやります。これを学術的には「Data Augmentation」と呼びます。

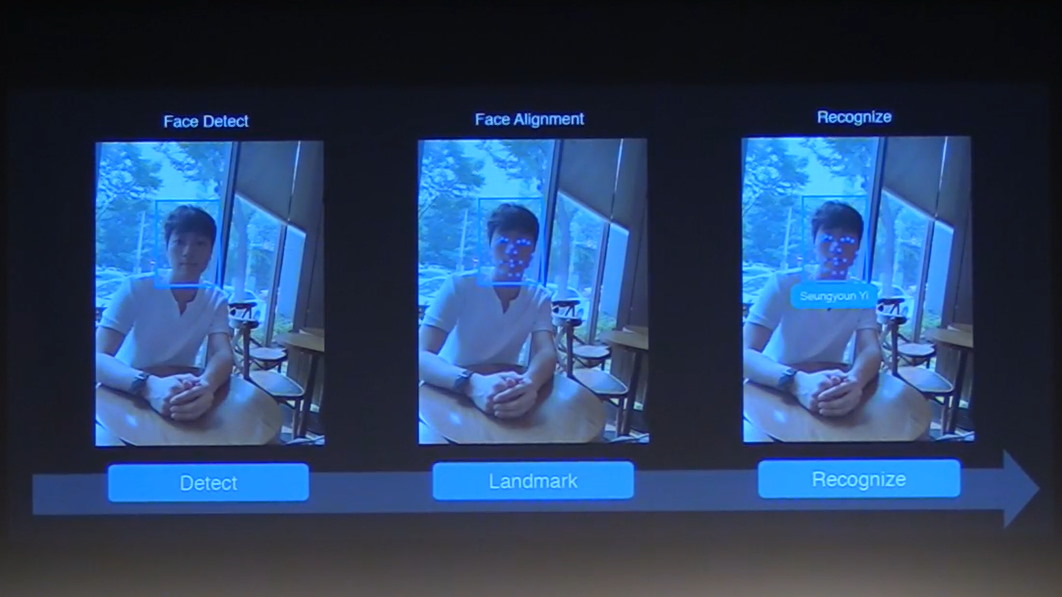

次にご紹介する技術は、顔認証です。最近は様々なデバイスがあって、空港のパスポートとの認証でも使っていますし、中国のニュースではこれからは顔認証で決済する時代とも言われています。

先日、LINE DEVELOPER DAYの受付でも使いましたが、皆さん同じように「速いですね!」とおっしゃいます。我々が目指すAIは小難しいものではなく、皆さんが本当に便利だと感覚的に理解してくれるものです。ですから、スピードを重視して実装をしています。

顔認識の技術は昔からあります。これをいかにスピーディーに正確性を高めた状態で実現するかというチャレンジをしています。例えば、クラウド側でやった方がいい処理とデバイス側でやったほうがいい処理をそれぞれ分離しながら、最適なユーザーエクスペリエンスを実現しようとしています。

文字認識(OCR)の話をして、顔認証の話をしてきましたが、これがコミュニケーションにどう連携してくるのかを応用例を紹介します。これら2つの技術ができているとeKYC(電子的な本人確認)が実現できます。

例えば、世田谷区役所に対して砂金さんが何かの処理をお願いしようとすると、LINE IDの砂金さんが本人であるかを確認する必要があります。本人確認が取れていれば、様々なことがコミュニケーションの中で解決できます。

しかし、そのラストワンマイルが実現できていないため、未だに窓口に行く必要があり、苦労するわけです。これを解決しようと、顔認証や文字認識の技術研究開発を進めています。

ここまで、我々の取り組んでいることのいくつかをご紹介してきました。LINEは自らサービスを作り出してきたインターネット企業なので、完全にユーザー目線です。ですから、プロダクトアウトではなくて、「この技術を使えば皆さんのサービスはこんなに良くなります、一緒に考えましょう」という提案ができると思います。

大事なこととして、ここは日本です。多くが日本語の話者であり日本語の書き手です。英語圏の方からすると、日本語の課題に対しては、割と優先度が低いのが実情です。人口1億人で、増える見込みもない国に対して、莫大な投資をするよりも、もっと他にやることあるといいます。

我々は、日本にきちんと根付いたサービスを今後展開していきますし、東アジア圏の各国の言葉が違うところに対してもフォーカスしてやっていきたいです。また、「なんでもできる」ということよりも、特定のことしかできなくても徹底的にチューニングして精度を出していきたいと考えています。

以上、どうもありがとうございました。

Communication Tech Conference2021開催決定

2021年2月26日(金)13時~『Communication Tech Conference 2021』を開催します。

下記バナーより特設サイトをご覧いただきます!

「テクノロジーは、人々のコミュニケーションをどう変えていくか」をテーマに、今回で3回目の開催となるカンファレンスです。なお、新型コロナウイルス感染症の拡大防止の観点から、初のオンライン形式で実施予定です。

新型コロナにより暮らしや働き方、それに伴うコミュニケーションが一変した中、テクノロジーはどのような進化を遂げているか。

特別ゲストに、Zoom創業者のエリック・ユアン氏、基調講演にソフトバンク社長 宮内謙氏の登壇が決定しました。また、ソフトバンク社によるテクノロジーデモセッションや、LINE社などによるトークセッションを行います。

さらに、「Work Style(働き方)」、「Customer Support(顧客サポート)」、「Entertainment(エンターテインメント)」をキーワードに、各分野を牽引する企業が登壇予定です。

この機会をぜひご活用ください。