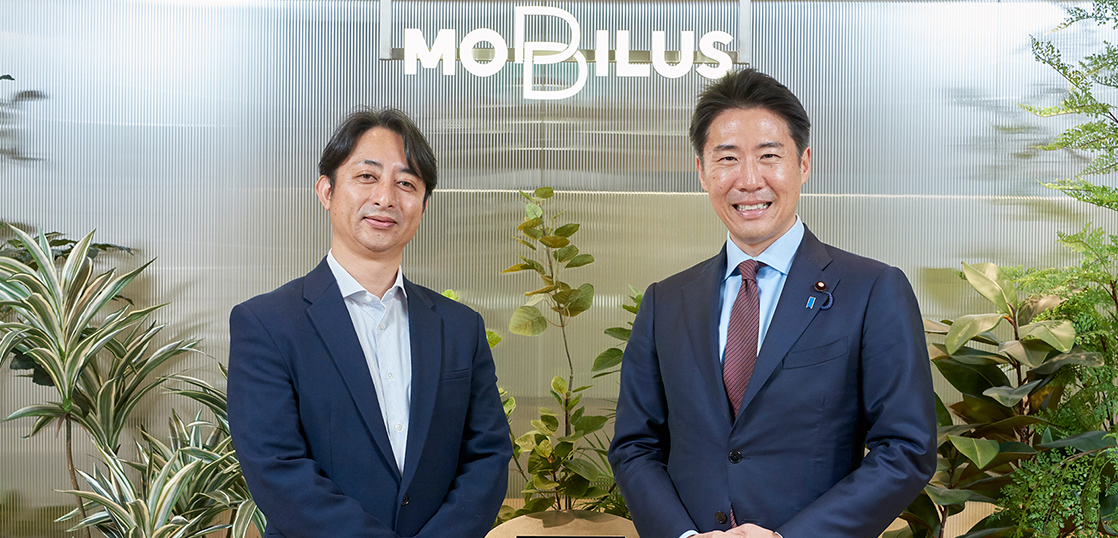

日本が世界に挑むAIテクノロジーとは|塩崎衆議院議員とモビルスのトップ対談【前編】

投稿日:2024年2月28日 | 更新日:2025年4月28日

海外諸国が生成AIの開発や利活用で台頭する中、日本はどういう方針のもとに進み、企業はどこに商機を見出すべきなのでしょうか。

日本における生成AIの利活用推進を政策面からリードする厚生労働省政務官 衆議院議員 塩崎 彰久氏をお招きし、モビルス株式会社 代表取締役社長 石井 智宏とのスペシャル対談を開催。両名は米国・ペンシルベニア大学ウォートン・スクールにてほぼ同時期にMBAを取得した間柄で、現在は政治とビジネスのそれぞれの領域で、お互いにAIの有効的な利活用をテーマに精力的に活動を展開しています。

日本の展望やAI戦略の課題と可能性、国内企業の勝ち筋などを政策とビジネスの両側面から徹底的に議論いたしました。そのほか、対談を聴いたモビルスメンバーから寄せられた質問にも、塩崎議員に回答いただきました。

前編、後編の2回にわたってお届けします。今回は前編をお届けします。後編はこちら。

【前編】

- 新しいテクノロジーが登場した際は、社会への影響などをできるだけ飛躍させた想像力で考えてみる

- AIが役立つ場面は「データがあるところ」。データの宝庫で世界的に競争優位のある医療分野も勝負していく

- 日本のAI規制は、企業のボランタリー・コミットメント(自発的な制約や責任)※1を政府に約束してもらう官民の“共同規制”を提案する計画

【後編】

■対談メンバー

厚生労働政務官 衆議院議員 塩崎 彰久

2021年7月に長島・大野・常松法律事務所のパートナー(共同経営者)を辞し、愛媛一区より第49回衆議院総選挙に立候補、初当選。弁護士時代は、危機管理・コンプライアンス分野の専門家としてオリンパス事件の告発を始め、多くの企業・組織の危機事案の解決に携わるほか、スタートアップ企業の支援に活躍。当選後は、自民党のデジタル社会推進本部『AIの進化と実装に関するPT』事務局長などを歴任し、日本国での生成AIの利活用を政策面でリード。2023年9月に厚生労働大臣政務官に就任。

1999年東京大学法学部卒。2000年スタンフォード大学大学院国際政策科(修士)。2010年ペンシルベニア大学ウォートン校MBA課程修了。

モビルス株式会社 代表取締役社長 石井 智宏

1998年 早稲田大学卒、2009年 ペンシルベニア大学ウォートンMBA取得。ソニー株式会社にて11年間ラテンアメリカ市場におけるセールスマーケティングに従事。MBA取得後、国内投資ファンドにて執行役員。その後ソニー会長率いるクオンタムリープ株式会社のエグゼクティブパートナーとして多数の日本企業の海外進出を実行支援。2014年モビルスに参画。受託開発中心のビジネスから業態チェンジをし、主力製品「MOBI AGENT」や「MOBI BOT」「MOBI VOICE」などをリリース。企業のコンタクトセンターや自治体向けに製品の提供、導入支援を行っている。

新しいテクノロジーが登場した際は、社会への影響などをできるだけ飛躍させた想像力で考えてみる

石井:

2023年は、ChatGPTを開発したOpenAI社のサム・アルトマンCEOが岸田総理大臣と面会したり、G7広島サミットの結果から「広島AIプロセス」が立ち上がったりと、国際的にも、日本政府においても、AI関連の議論が活発に行われました。AIの領域では塩崎さんがかなり率先して動かれたと思いますが、そもそも塩崎さんは、なぜ生成AIに大きな可能性があると思われたのでしょうか?

塩崎氏:

よく、「塩崎さんって、もともとAIが大好きだったんでしょう?」と聞かれるのですが、実は全然そういうわけではありませんでした。2022年に自民党デジタル社会推進本部のWeb3プロジェクトチームで事務局長に就任し、1年間ずっとブロックチェーンの推進に努めていたのですが、ご存じのとおり、クリプトウィンター(暗号資産冬の時代)が訪れましてね。そのときに周りの政治家も「これからはAIだ!」と話すようになったんです。2022年11月頃にローンチされたChatGPTを見ても、これはすごいことかもしれないと気付かされました。

何がすごいかというと、これだけの機能の人工知能がほぼ無料で使えること。何の前触れもなく、そんな時代が来たわけです。生成AIによって、働き方や余暇の使い方まで、生活のあらゆるものが変わっていくのではないか――。それに対応するのが政治の役割だと考え、2023年1月に党で「AIの進化と実装に関するプロジェクトチーム(以下、AIプロジェクトチーム)」を立ち上げ、日本のAI戦略や政策提言についての検討をスタートしました。

石井:

AIプロジェクト発足後、何か大変だったことはありましたか?

塩崎氏:

最初は、ChatGPTをはじめとする生成AIがいかに目覚ましい技術であるかを、自民党内で理解を広めていくことに苦労しました。比較的、若手の議員はすぐにChatGPTを使い始めていたのですが、ご年配の議員からは「AIはいろいろと間違いを起こすらしいから使えない」と、懐疑的に見られることも少なくなかったからです。そうおっしゃる先生方に私は、「ちょっとスマホを貸してください!」とその場でChatGPTをインストールして、「試しに地元の後援会関係者への弔電を書いてもらいましょう」といった具合に、一人一人にデモンストレーションをしていったんです。すると、結果を見た瞬間、AIに懐疑的だった先生も表情が晴れるほど感動して、ほかの議員にも広めてくださるようになり、そうやって党内でのAIへの理解を深めてこられました。今や、ChatGPTをよく使う業種の一つが政治家かもしれないほどです。

そんな中で2023年3月、伊藤穰一さん(千葉工業大学変革センター長、同大学長)と松尾豊さん(東京大学教授)からの紹介で、サム・アルトマンとオンラインで対話する機会が設けられたのですが、そこで当時はまだ世に出ていなかったGPT-4のデモを見せていただいたんです。デモ内容は、イタリアのローマの写真を用いて、「こんなイメージのイタリアンレストランを品川でオープンしたいから、そのホームページのコードを書いてください」と言うと、イメージと映像とテキストを取り込んでウェブサイトのコードを書くというものでした。それは、最近ようやくGPT-4 Turboで始まった、マルチモーダルAI※2だったんですね。これを見せられたときは「すごい!人々の仕事が変わる!」と痛感し、本質的な国家戦略を立てなければならないと、検討が本格化しました。

石井:

私たちはそういった技術をいかに使って、どう商売をするのか、どんなソリューションを提供するのかという発想で行動に移す立場にありますが、塩崎さんのような国のリーダーを担うお立場では、新しい技術が登場したときに、どういう視点で活用しようだとか、取り扱っていこうという発想になるのでしょうか?2023年春にAIプロジェクトチームから「ホワイトペーパー~AI新時代における国家戦略~」も出されていらっしゃいますが、ぜひ改めてお聞かせいただけますか?

塩崎氏:

以前のWeb3のときも同様でしたが、新しいテクノロジーが登場した際はまず、社会にどういう影響を与えるのか、できるだけ想像力を飛躍させて考えてみるようにしています。「(新しいAIによって)仕事や働き方が変わって、人手不足の問題は解消できるかもしれない。これは素晴らしいことだが、一方で、失業の問題が生じるかもしれない。ほかにも、著作権やフェイクニュースの問題も出てくるかもしれない。また、安全保障の面ではどうだろう」――と、もう次々と新しい議論が浮上してくるわけです。

政治家というのは、あらゆる社会課題に対して、最終的な責任を負う立場にあります。新しいテクノロジーに対して、今までの政府のAI戦略・AI政策で対応できるのかをチェックしたときに「対応できない」となると、もう一度トータルプランを作らなくてはいけません。こうした経緯から、ホワイトペーパーを出すことになりました。

実は、これまでの自民党では「ホワイトペーパー」という言葉自体をあまり使ったことがなかったのですが、いろんな省庁にまたがるトータルな政策パッケージとなるため、「ホワイトペーパー」という形で提出しました。このスライド版のフロントカバーや、英語版などは生成AIで作ったんです。

モビルスが生成AIを取り込もうと思ったのも同じく2023年3、4月頃だったそうですから、相当早い時期に着目されていますよね。

石井:

そうですね、この流れに乗らないといけないと。私たちの携わるコールセンター業界は、“人”から“自動化”へと大きく振れていくだろうという感覚でした。

ところで、AIプロジェクトチームでは、どういった取り組みや活動をしているのですか?

塩崎氏:

毎週のように有識者をお呼びしてプレゼンテーションをしていただき、そこから知識を得て、政策に落とし込む取り組みをしています。政治家だけでなく、関係省庁の人たちも参加して、有識者の話を全て聞きながらそれぞれの役所でどう政策を直すべきか考えてもらうようにしています。

石井:

有識者からさまざまなプレゼンテーションを聞いてこられたと思いますが、塩崎さんにとって特に印象的だったお話をお伺いできますか?

塩崎氏:

松尾豊さんが、「(ChatGPTなど)こういう技術が出てくると、キーボードを打たなくなる時代がやって来るかもしれない。口頭で指示をすればやってくれるような時代が来ると、あらゆるホワイトカラーの仕事は変わるかもしれない」とおっしゃっていたことです。それほどインパクトが強い技術だと分かったときに、「あ、これは世界が大きく変わるな」と。

コールセンターも、人がやらなければいけなかったことや、人でしかできないことの定義が大きく変わるかもしれないという、石井さんの感じ方と近かったのではないかと思います。

石井:

AIプロジェクトチームのカバーしている領域は、とてつもなく広範にわたるということですね。

塩崎氏:

その通りです。なので、いろんな方々の話を聞きながら、想像力を足していく作業が大切なんです。ですが、それはビジネスでも同じですよね。新しい技術が出てきたときに、石井さんがそれをコールセンターや隣接するビジネスでどう使えるかと考えるように、皆さんものすごく想像力を働かせていると思いますし、そうやって新しい発想が浮かんでくると思いますから。

AIが役立つ場面は「データがあるところ」。データの宝庫で世界的に競争優位のある医療分野も勝負していく

石井:

今後生成AIが本格的に普及していったときに、国や行政での利活用にはどのような可能性があると思いますか?厚生労働省の管轄分野でも生成AIがかなり活用できるかと思いますが、塩崎さんが思い描くイメージをぜひお聞かせいただきたく思います。

塩崎氏:

今、厚労省の中に「ChatGPT利活用チーム」を立ち上げ、日々の業務のどういった部分でChatGPTが使えるかを議論しています。直近の活用例を挙げると、厚労省が1月に初めて医療分野のAIシンポジウムを開催したのですが、そのフライヤーのデザインはChatGPTで作ったんですよね。これまで広告代理店に発注して、費用をかけて作ってもらわなければいけなかった分が、一切不要になりました。また、会議の議事録をサマライズしたり、さまざまな想定問答の下書きをしたりする業務にも活用できるのではないかと考えています。

このほか、新しい法律を作る際に「この用語の統一がされていないのではないか?」「他の法律と違う用語の使い方をしていないか?」などを確認するネガティブチェックという作業があるのですが、そこにもAIを活用できるのか、デジタル庁を中心に各省庁で検討と実証実験を行っています。

そこでネックになるのが、機密情報をAIでどこまで取り扱っていいかということです。役所の世界では、機密性1、2、3※3の基準があるのですが、今のところ通常は機密性1までしか使ってはならず、Azureサーバー上であれば機密性 2まで使えると決められています。

石井:

ちなみに、現時点ですでにAIを活用している事例などがあれば、少しお教えいただけますか?

塩崎氏:

一例として、社会保険診療報酬支払基金の事例が挙げられます。私も12月に視察してきたのですが、ここでは皆さんが病院にかかったときに、「この人はこういう診察をして、レントゲンを撮って、こういう薬が出て、いくら支払った」と出るレセプトを全国からまとめて、過大請求や間違った処方をしていないかなどをチェックしています。1年に約10億枚ものレセプトが集まってきており、以前は職員の目で一生懸命チェックしていたのですが、さすがに無理がありました。

今はAIによる仕分けシステム「RECAI(リカイ)※4」を導入して、人間が目視しなければいけないレセプトの枚数が以前の半分以下まで削減できています。人の労力を軽減でき、財政的にも助かるシステムがすでに活用され始めているので、今後も行政の中で新しい技術の使い方は、どんどん出てくるのではないかと思っています。

ChatGPTのような右脳的なAIや、「RECAI」のような左脳的なアルゴリズムベースのAIなど、さまざまなAIが登場していますが、それぞれの特性に合わせて行政のどの場面で活用するのか、今は試行錯誤している段階ですね。

石井:

先ほど塩崎さんがおっしゃったように、情報セキュリティの観点は企業側も行政と全く同じで、「(生成AIを)使いたい」「使うべき」というステージに前進できていない最大要因はそこにありますよね。

塩崎氏:

そう思います。例えばコールセンターにおいても、ものすごくデリケートな相談内容があったときなどは、それを生成AIに読み込ませていいのかと聞かれますよね?

石井:

聞かれます。一番ニーズが高くて分かりやすい例で言うと、通録(通話録音)が挙げられますね。膨大な量の対話履歴が音声で残っており、ここからFAQやVOC(顧客の声)などが出せる、まさに宝の山と言えるのですが、こうしたデータを取り出すにも情報セキュリティがボトルネックとなってしまっているんです。通録には個人情報が混入している可能性があり、しかもそのデータは現在のところ基本的にオンプレミス環境で管理しているので、クラウド環境に出すとなると、相当な抵抗感があるようです。

その点、医療分野で生成AI活用が進むと、多大なインパクトが与えられると思うので、私たちとしてもすごく期待しています。

塩崎氏:

AIが最も役に立つ場面はどういうところか、平たく言うと「データがあるところ」です。要するに、膨大なデータを人間が解釈できるようにカスタマイズしたり、デフォルメしたりしてくれるのがAIだとすると、やはり膨大なデータがあるところにはチャンスがあるということ。そういった意味では、日本はまさに医療データの宝庫と言えるんですね。

国民皆保険で、なおかつマイナンバーカードであらゆる情報がつながっている。こういう国は、実は世界でもなかなかないんですよ。その上、レントゲンやMRI、CT検査などの利用は、世界の中でも日本はとても多い国です。こういったデータとAIを活用して創薬や治療に役立てるなど、さまざまな取り組みができるようになれば、AI分野で先進的な米国、中国、イスラエルなどでもできないことが日本でできる可能性は十分にあります。

中国では、1000億パラメータ規模の巨大な医療統合型AIが開発されつつあり、一気通貫で診療から創薬まで全てできるようなものも出始めているわけですが、日本もヘルスケア領域でのAI利活用は本当に大きなチャンスがあります。先ほど石井さんが「乗り遅れてはいけない」とおっしゃっていたように、日本にとって医療・ヘルスケアは競争優位がある分野なので、勝負しなければいけないと考えています。

モビルス社員:

先ほど、行政機関では機密性3以上の機密情報はどのような環境でもAIで取り扱えないことと、社会保険診療報酬支払基金でAIを活用されている事例についてお教えいただきましたが、そこに関して一つ質問です。レセプトなどの医療情報には、機微な情報が多く含まれていると思いますが、AIで取り扱えない情報についてはどこに課題を抱えていて、解決のためにどうアプローチされようとしているのでしょうか?

塩崎氏:

現在の厚労省では、機密性1は生成AIの活用が可能、機密性2はAzureサーバーであれば可能、機密性3は使ってはいけない――となっていますが、やはり情報の機密性の度合いに応じて、使っていいのか、いけないのか、かなり慎重に判断しなければならないのは事実です。その上で、社会保険診療報酬支払基金のレセプトの仕分けにおいては、個人情報を抜いた形でAIを活用するようにしています。

モビルスの皆さんはよくご存じだと思いますが、生成AIに情報を学習させることは、まるで海の中に塩を溶かし込むようなもので、一度学習させた情報を取り出すことはほぼ不可能です。それを前提に、厚労省も機密性に応じてAIを活用し始めた段階です。まだ始まって2年目なので、かなり慎重に手探りしている状況ですが、これくらい注意深く進めていった方が、長期的にはAIがより広く社会に安心して受け入れられるのではないかと考えているので、まずは慎重さを第一に取り組んでいきたいと思っています。

モビルス社員:

多くの人が日常的にGoogle検索を利用し、学習されていることには抵抗感が少ない一方で、生成AIでの情報の取り扱いについては、良い学習ができれば高い成果が出るにもかかわらず、特に個人情報を含む場合にはまだ相当な抵抗感を持たれていると感じています。

2009年に米国とメキシコ周辺を発端とする新型インフルエンザが世界的に流行した際、全国の保健所が初めてインターネット上に情報を収集してSaaS利用の安全性の証明につながったほか、昨今のコロナ禍でも、いわゆる個人情報保護法制の「2000個問題」の壁を乗り越えて、インターネット上でワクチン接種予約ができるようになりました。このように、これまで厚労省が多くの壁を突破し、民間企業にも良い影響が波及してきた実績があるので、厚労省政務官である塩崎さんにはぜひ、生成AIの利活用推進に向けたお取り組みに引き続き尽力いただければと願っています。

塩崎氏:

ありがとうございます。危機や災害等の発生時は、新たなイノベーションを生み出す大きなきっかけにもなると捉えています。実のところ日本は、個人情報をAIに学習させる上で本人同意が必要ないとされている、極めて珍しい国の一つです。そういった意味では、もともと日本はAIにフレンドリーな土壌があると考えられます。例えば、災害対応の際に要配慮個人情報までコンセンサスなしに読み込ませていいとなったとき、どういう国民に便益が提供できるのか、そこが見えてくれば十分に議論する意義が高まると思いますね。

この数年の間でも、コロナ禍を機に遠隔医療などの規制緩和が進んだ側面もあります。AI活用も同様に、さまざまなイノベーションが進められる新しいAIの使い方があれば、今後も積極的に応援していきたいと考えています。

日本のAI規制は、企業のボランタリー・コミットメント(自発的な制約や責任)※1を政府に約束してもらう官民の“共同規制”を提案する計画

石井:

EU諸国や米国などでは、AIの利用制限に関する議論が活発化しているように思いますが、日本におけるAIの利活用規制の考え方は今、どのようになっているのでしょうか?

塩崎氏:

AIをめぐる規制についての哲学は、本当に国によって異なるなと感じています。昨年、ワシントンD.C.で開催された「グローバルAIフォーラム in DC」に参加し、米国や欧州のローメーカー(政治家や議員など、法律を作る人)と議論したのですが、欧州は法文化な傾向にある分、ハードロー(法的拘束力のある法律)のもとできちっと取り決めたい意向が強く、「EU AI Act」を作って、AIでやっていいことといけないことをちゃんと法律に書こうという考えを持っています。EUはAIごとにレベルを区分けして、それぞれに規制をかけ、なるべくグレーゾーンがないようにしながら、EU全体で共通の透明かつ厳しいルールのもと、人権を守っていこうというスタンスです。

一方の米国は、ハードローのEUよりは規制を緩くしたい考えを持っています。企業にボランタリー・コミットメントを出してもらう形で、違反しても特に罰則はありません。米国はどちらかというと、企業のイノベーションを尊重するようなアプローチをとっているわけです。

では、日本はどうするのかということですが、今は「AI事業者ガイドライン」を経済産業省や総務省が製作を進めている状況です。ですが、近く仲間とともに、EUと米国の中間で若干米国寄りの“共同規制”の方式を提案していていこうと考えています。簡単に言うと、米国でOpenAIやGoogle、Microsoftなどがボランタリー・コミットメントで実施している制約を、日本政府に対しても約束してもらい、実行する義務を負ってもらうということです。例えば「このAIのローンチ前に、レッドチーミングテスト※5を実施します」「AIを開発したら、その仕様を公表します」「AIによる被害が出たら、それをちゃんと政府に報告します」など、いくつかの主要な安全基準について、やり方をこちらから事細かに指図するのではなく各社で判断するにしても、少なくとも機能を持たせることを法的な義務で負ってもらう。こういった形の規制を提案したいと思っています。

実はこの規制の形は、モバイルサービスのプラットフォーム規制と似ています。iOSやAndroidなどのモバイルOSプロバイダーは、一定の報告を経産省に対してしなければならず、その内容を評価されるという官民共同での規制の形になっています。

それと、規制に関してはもう一つ、ディープフェイクには何らかの規制が必要だと思っています。今や、あたかも私が人種差別的な発言をしているかのような動画が、多言語で簡単かつ瞬時に作れますよね。このようなディープフェイク動画を選挙の前に流されて、印象操作されるなどしたら、これはもう民主主義の危機だと思うのです。民主主義というのは、「誰が喋ったか」という言論に偽りがないことが最低限の前提となったシステムなので、こういったディープフェイクなどに対しては、一定の法的規制をかけていくことも考えなければならないのではなかと考えています。

石井:

2024年は米国の大統領選挙も控えているので、ディープフェイク動画などはたくさん出てくることが懸念されますね。

塩崎さんがおっしゃる通り、ディープフェイクは民主主義への脅威にもなりますし、ほかにも軍事・安全保障面での危惧や、企業価値も簡単に棄損される恐れがあるなど、すごく幅広いインパクトがあるのだろうと思っています。

塩崎氏:

そうですね。今まで私たちは、「写真や映像で見たものは本物だ」という世界で生きてきたわけです。そこからパラダイムシフトしなければならない世界に入っていることに、まだあまり気付けていない状態だと言えます。“情報”というものにどういうウェイトを置くのか、ゲームルールが大きく変わってくるわけですから、そこに政治のシステムとしては最も危惧を抱いています。

2024年は1月の台湾総統選挙に始まり、3月にはロシア大統領選挙、11月には米国大統領選挙と、大きなイベントが続きます。ディープフェイクが氾濫する可能性は十分ありますから、私たちもよく見ておかなければいけないと思いますね。

石井:

ちなみに、何がディープフェイクで、何がアートなのかなど、法律を作る上でここの線引きが難しそうに思うのですが、塩崎さんはどう考えていらっしゃいますか?

塩崎氏:

やはり、その発言者に断りなく何かを喋らせたり喋ったことにしたりするのは、法的に守る価値のない表現だということで、社会的なコンセンサスが取れればと考えています。全くの架空の人物が何か喋っている動画等を作るのはアートとして捉えてもいいと思うのですが、例えば石井さんや私が何か喋っているものを本人の人格に許可なく行う必要は、本来ないはずですよね。そこは規制していくべきかと今は考えていますが、これに関しては大激論に発展するかもしれないとも思っています。